视觉定位导航

多自由度抓取

人体动作识别

离线语义理解

传感器拓展

深度视觉处理

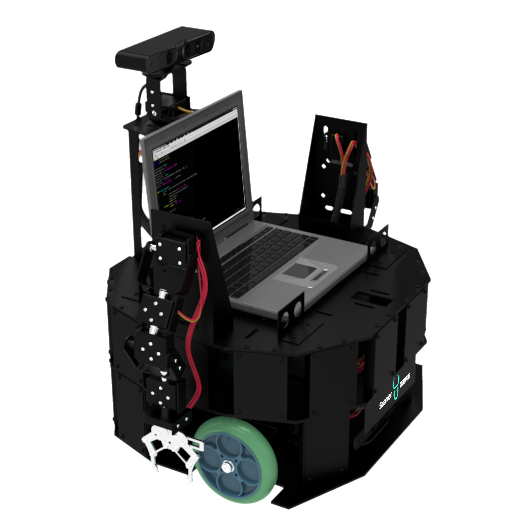

基于视觉的定位导航模块主要根据深度摄像头获取带有深度信息的图像数据,可用于计算前方可行区域;点击编码器通过计算车轮旋转角度,推算当前航位从而记录环境中特殊的位置

人体动作识别模块尅识别人体约16个关节节点,并计算出每个节点之间的相对位置、旋转角度以及运动速度。从而方便机器人进行人体手臂动作模仿实验,也可以实现人脸识别和手势识别实验。

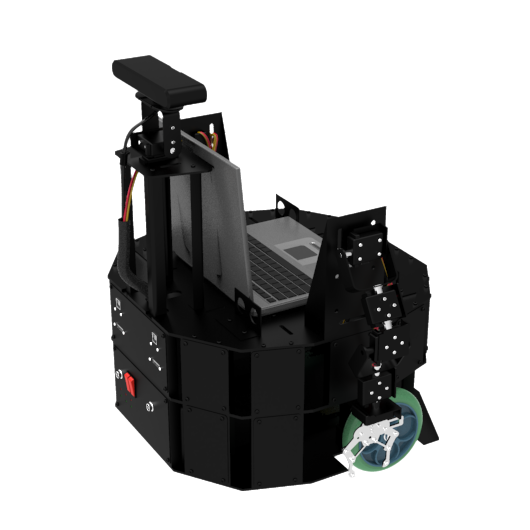

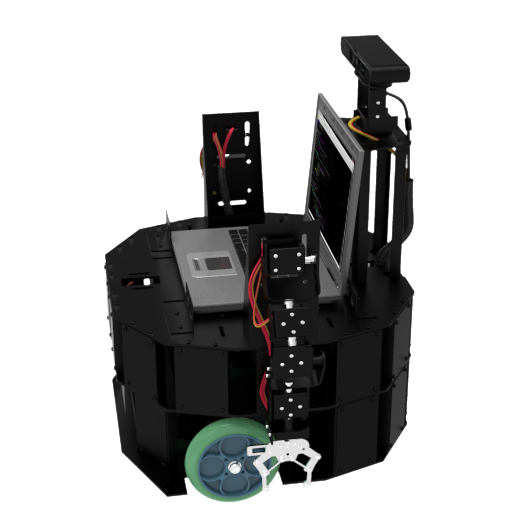

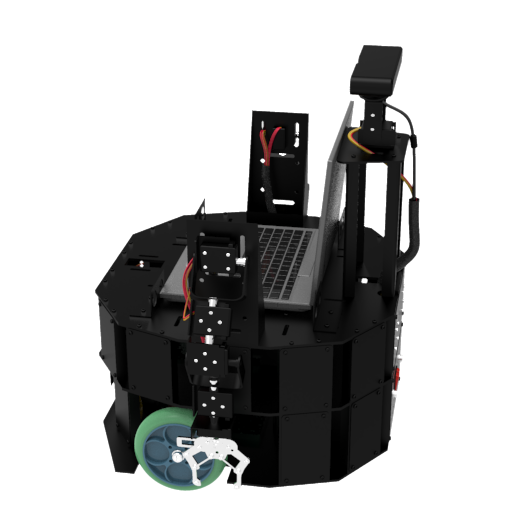

多自由度抓取模块包含六自由度机械臂以及二自由度视觉云台,机械臂与视觉云台相互配合,通过相关摸索开发可以实现物品特征识别与自动抓取。同时视觉云台可安装人体动作识别模块以实现木白哦人物跟随和人体手臂动作模仿实验。

语义理解技术,使机器人通过识别和理解,将语音信号转变为相应的文本或命令。语音识别旨在为机器人赋予人的听觉特性,听懂语音命令,并执行相应的动作。

通用机器人控制扩展板,整合多个Arduino控制器,控制器间采用Master-slave结构,即以一个处理器为主,其他处理器为辅,可扩展各种功能,搜集传感器数据,驱动其他扩展,支持三条六自由度机械臂的同时工作。

深度视觉处理模块通过红外发射器射出激光,通过红外发射器前的光栅,均匀地投射到测量空间,通过晶片的计算便得到深度图像,相对于二维图像,深度图像可以获得更多内同信息,可以实现更多视觉算法与实验。

在ROS的基础上进行了深度定制,针对教育机器人解决方案做了50多项优化 使得机器人的操作更加便捷更加稳定

分布式的进程框架

多进程间的消息传递

可视化操作

BSD协议开源

我们针对大学生的机器人教育制定了具有特色的配套课程 让学生学以致用,快速提升

即时定位与地图构建

机器人从未知环境的未知地点出发,在运动过程中通过重复贯彻到的地图特征定位自身的位置和姿态,再根据自身位置增量式地构建地图,从而达到同时定位和地图构建的目的。

基于视觉的人体动作捕捉与体感控制

通过对人体动作的捕捉和识别,控制机器人远程动作模仿,抓取物品等。

语音识别与语义理解

实践基于隐马尔科夫的语音识别算法,自然语言处理相关的语音识别算 法,基于机器学习的语义处理算法。

标准接口的下位机控制板和ROS的拓展性能模块为用户提供了丰富的接口 通过插入不同功能的传感器用户可以几乎实现任何常见传感功能

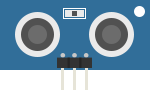

超声波测距模块

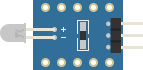

红外线发射传感器

声音传感器

激光发射器

火焰传感器

有源蜂鸣器

避障传感器

机器人底盘

机器人机载计算机

深度视觉系统

机器人六自由度机械臂

底盘控制器

底盘物理参数

输入/输出接口

电机参数

处理器

芯片组

内存

硬盘

显卡

显示器

摄像头

系 统

云台电机参数

二维云台

深度摄像机

最大臂展

机械臂电机数

机械臂电机控制方式

电机参数